通义千问首次落地天玑9300移动平台

3月28日,阿里云与知名半导体公司MediaTek联合宣布,通义千问18亿、40亿参数大模型已成功部署进天玑9300移动平台,可离线流畅运行即时且精准的多轮AI对话应用,连续推理功耗增量不到3W,实现手机AI体验的大幅提升。这是通义大模型首次完成芯片级的软硬适配,仅依靠终端算力便能拥有极佳的推理性能及功耗表现,标志着Model-on-Chip的探索正式从验证走向商业化落地新阶段。

端侧AI是大模型落地的极具潜力的场景之一。利用终端算力进行AI推理,可大幅降低推理成本、保证数据安全并提升AI响应速度,让大模型可以更好地为用户提供个性化体验。然而,要将大模型部署并运行在终端,需完成从底层芯片到上层操作系统及应用开发的软硬一体深度适配,存在技术未打通、算子不支持、开发待完善等诸多挑战。

据了解,通义千问18亿参数开源大模型,在多个权威测试集上性能表现远超此前SOTA模型,且推理2048 token最低仅用1.8G内存,是一款低成本、易于部署、商业化友好的小尺寸模型。天玑9300集成MediaTek第七代AI处理器APU790,生成式AI处理速度是上一代AI处理器的8倍。

阿里巴巴通义实验室业务负责人徐栋介绍称,阿里云与MediaTek在模型瘦身、工具链优化、推理优化、内存优化、算子优化等多个维度展开合作,实现了基于AI处理器的高效异构加速,真正把大模型“装进”并运行在手机芯片中,给业界成功打样端侧AI的Model-on-Chip部署新模式。

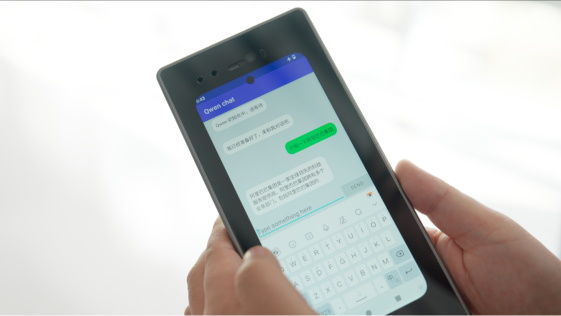

图:在天玑9300设备上,可离线完成基于通义千问大模型的AI多轮会话

基于天玑9300芯片,通义千问18亿参数大模型在推理方面表现出了极佳的性能与功耗表现,推理时CPU占有率仅为30%左右,RAM占用少于2GB,推理速度超过20tokens/秒,系列指标均达到业界领先水平,可在离线环境下流畅实现多轮AI对话。据了解,相关成果将以SDK的形式提供给手机厂商和开发者。

此外,双方团队也已完成了通义千问40亿参数大模型与天玑9300的适配,未来还将基于天玑适配70亿等更多尺寸大模型,“打样”并支持开发更多AI智能体及应用。

MediaTek无线通信事业部副总经理李彦辑博士表示:“阿里云的通义系列大模型是AI领域的佼佼者,我们期待通过双方的合作可以为应用开发者和终端客户提供更强大的硬件和软件解决方案,同时促进生成式AI的端侧部署以及AI应用、AI智能体生态的快速发展,为用户带来更多令人兴奋的AI产品体验。”

当天,阿里云与MediaTek宣布启动联合探索AI智能体解决方案计划,整合MediaTek天玑移动平台的AI算力及阿里云通义千问的大模型能力,为开发者和企业提供更完善的软硬联合开发平台,以更好支持智能终端在端侧高能效地实现自然语言理解、复杂决策制定以及个性化服务生成,探索打造真正具备情境感知、自主学习和实时交互功能的下一代智能终端应用生态。

通义大模型已在各行业广泛落地,包括钉钉、淘宝、一汽红旗、央视网、浙江大学等众多应用、企业及机构。“淘宝问问”基于通义千问实现了全新的交互体验以及更精准的推荐;阿里云与中国一汽联合打造的大模型应用GPT-BI已率先落地,可结合企业数据自动生成分析图表。

关键词: 阿里云 MediaTek AI 通义千问 天玑9300

加入微信

获取电子行业最新资讯

搜索微信公众号:EEPW

或用微信扫描左侧二维码

相关文章

-

-

2024-06-04

-

-

-

-

-

-